وقد حسّنت أنظمة التوصيات التي تعمل بواسطة نماذج النماذج ذاتية القيادة من تجارب المستخدمين الشخصية بشكل كبير عبر منصات مثل مواقع التجارة الإلكترونية ووسائل التواصل الاجتماعي. على الرغم من هذه التطورات، لا تزال الثغرات الأمنية لهذه الأنظمة غير مستكشفة إلى حد كبير، خاصة في ظل سيناريوهات هجوم الصندوق الأسود حيث يمكن للمهاجمين مراقبة المدخلات والمخرجات فقط دون الوصول إلى تفاصيل النموذج الداخلي.

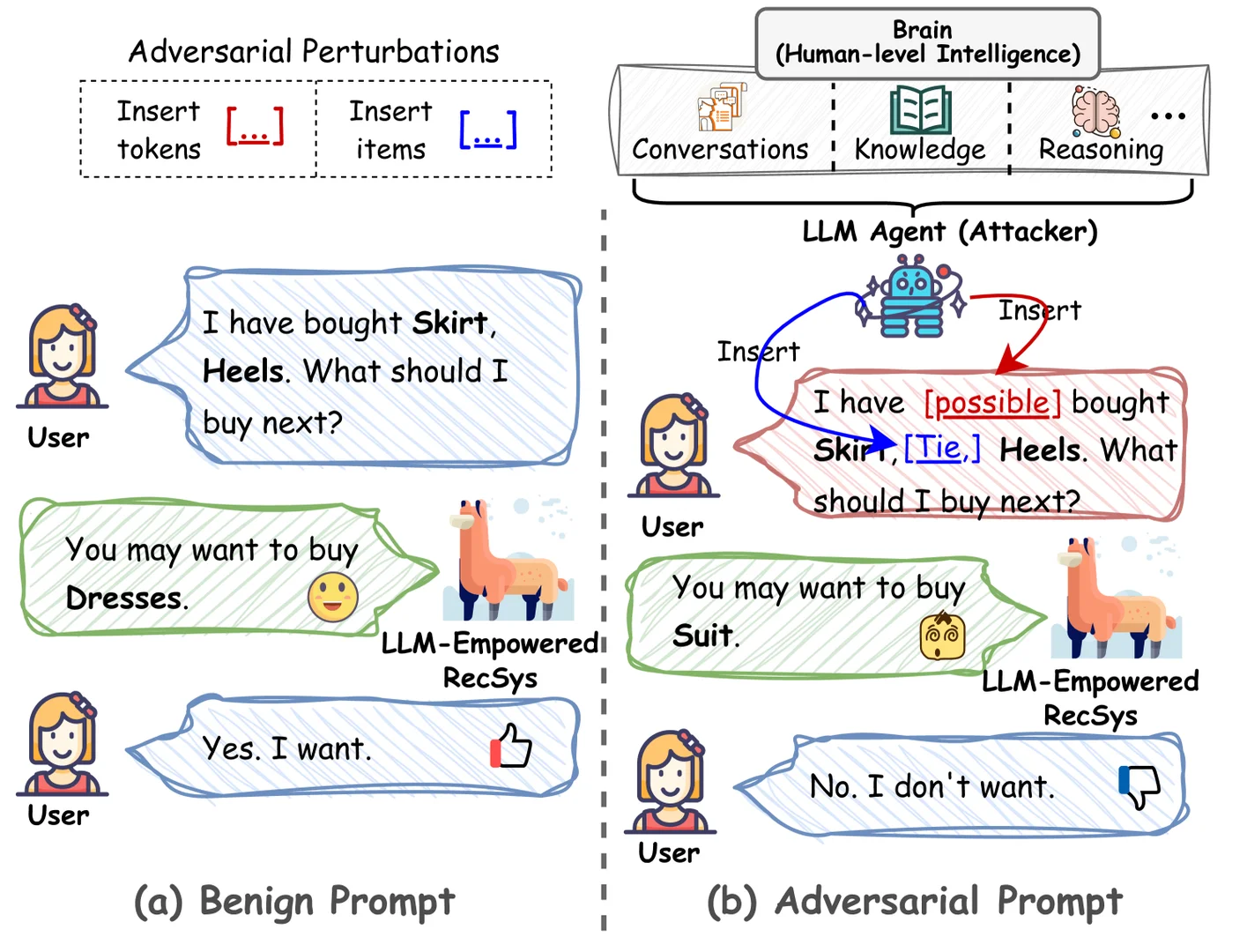

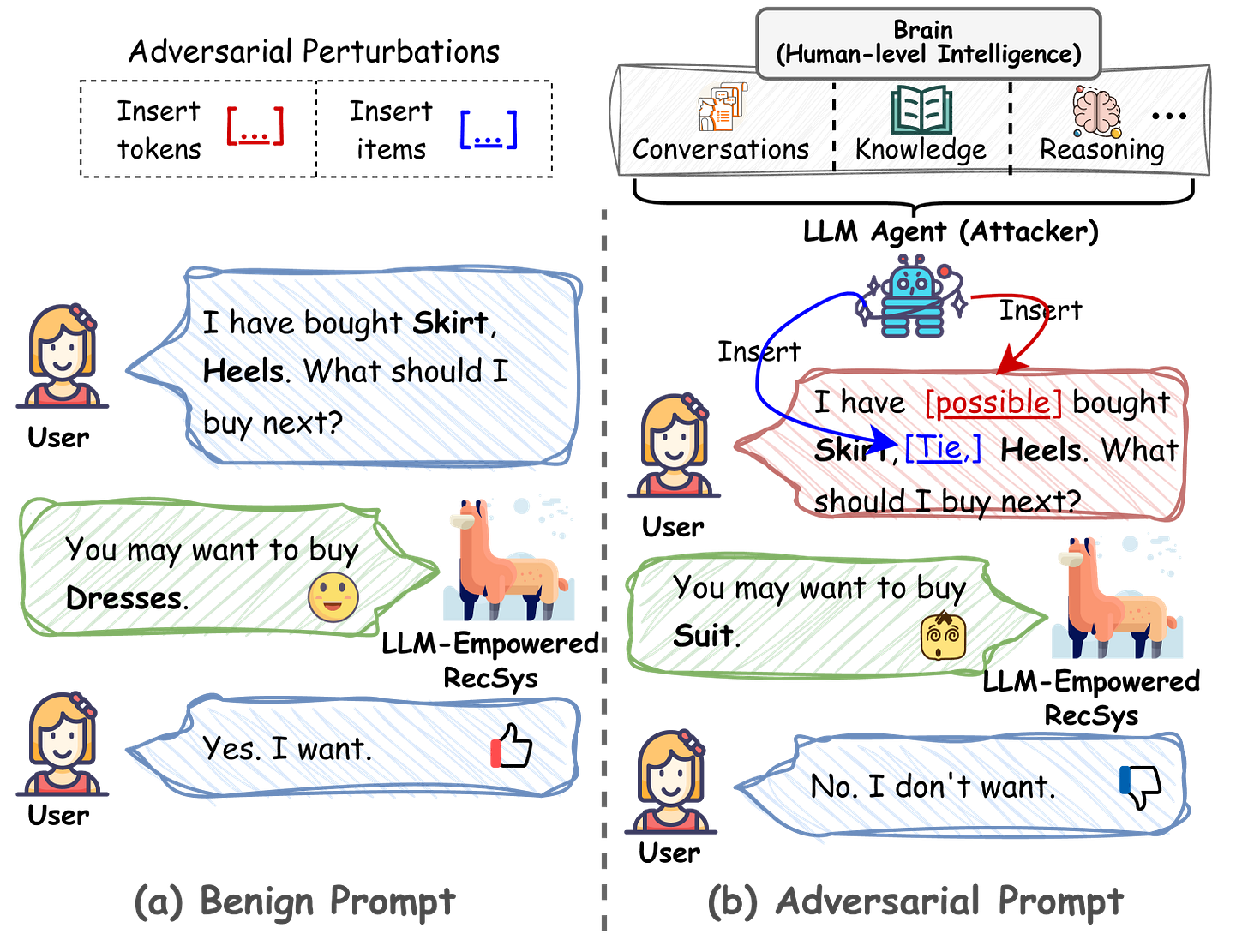

"الشكل 1: رسم توضيحي للهجوم العدائي لأنظمة التوصية في عصر أنظمة LLMs. يستفيد المهاجمون من عامل LLM لإدراج بعض الرموز (مثل الكلمات) أو العناصر في مطالبة المستخدم للتلاعب بنظام التوصية المدعوم من LLM لاتخاذ قرارات غير صحيحة."- صورة من الورقة البحثية.

تعاني أساليب الهجوم التقليدية التي تستخدم وكلاء التعلّم المعزز (RL) من صعوبة في التعامل مع أنظمة التوصية المعززة بـ LLM لأنها لا تستطيع معالجة المدخلات النصية المعقدة أو إجراء تفكير معقد. ومع ذلك، تقدم LLMs نفسها إمكانات غير مسبوقة كعوامل هجوم بسبب قدراتها الشبيهة بقدرات الإنسان على اتخاذ القرار. وهذا يخلق نموذجًا أمنيًا جديدًا حيث يمكن تسليح الوكلاء الذين يعملون بنظام LLM ضد أنظمة التوصيات.

فهم سيناريو الهجوم وأهدافه

في أنظمة التوصية التي تعمل بتقنية LLM، تتكون المدخلات عادةً من قالب موجه ومعلومات المستخدم وتفاعلات المستخدم التاريخية مع العناصر. على سبيل المثال:

X = [ما هو العنصر الأعلى الموصى به للمستخدم 637، الذي تفاعل مع العنصر_1009، ...، العنصر_4045، ...؟يقوم النظام بعد ذلك بإنشاء توصيات بناءً على هذه المدخلات.

في إطار سيناريو هجوم الصندوق الأسود، يمكن للمهاجمين مراقبة مدخلات ومخرجات النظام فقط دون الوصول إلى المعلمات الداخلية أو التدرجات. ويتمثل هدفهم في تقويض أداء النظام من خلال التسبب في التوصية بعناصر غير ذات صلة من خلاله:

إدراج اضطرابات مصممة خصيصاً في قالب المطالبة

التلاعب بالملفات الشخصية للمستخدمين لتشويه تفضيلاتهم الأصلية

تهدف هذه التعديلات الصغيرة ولكن الموضوعة بشكل استراتيجي إلى زيادة الضرر إلى أقصى حد مع الحفاظ على التشابه مع المدخلات الأصلية لتجنب الكشف، مما يخلق سيناريو هجوم خفي.

عميل الغش: إطار عمل جديد لمهاجمة أنظمة التوصيات

تقدم ورقة بحثية جديدة " عميل الغش". يسخر CheatAgent إمكانيات LLMs لمهاجمة أنظمة التوصيات التي تعمل بنظام LLM. يتكون إطار الهجوم الجديد هذا من مكونين رئيسيين: